结合属性信息与对偶注意力的实体对齐关系感知邻域匹配模型

王小鹏,李 丹

(1.桂林电子科技大学 计算机与信息安全学院,广西 桂林 541004;

2.桂林信息科技学院,广西 桂林 541004)

近年来,知识图谱(knowledge graph,KG)在人工智能和自然语言处理领域大放异彩,现有的大型开源知识图谱包括DBpedia[1]、YAGO[2]、Freebase[3]等。然而,大多数知识图谱是基于不同数据源根据不同需求构建而来的,不可避免地存在信息冗余与数据异构问题[4]。为了能够有效利用知识图谱间互补的信息,实体对齐在指向现实世界中同一事物的实体间建立等价映射,实现知识图谱间信息共享,从而向上提供一个信息完备的知识库。

自从Wang等[5]首次将图卷积网络(graph convolutional network,GCN)引入到实体对齐任务中,便开创了以GCN为基准的方法拓展模型,从而很多研究者把前面使用较多的以TransE翻译表示模型方法的基准模型的目光转移到了GCN,开启了以GCN模型为基础模型的热门方向。实体对齐基于GCN的主要方法有以下几种:多通道图神经网络(multi-channel graph neural network,MuGNN)[6]将GCN引入实体对齐中,基于自注意力的知识图谱补全和跨语言注意力的实体修剪的多通道;

关系感知双图卷积网络(relation-aware dual-graph convolutional network,RDGCN)[7]引入了双向对偶图的概念,并通过限制双向对偶图来增强对不同实体网络结构的歧视;

关系感知邻域匹配(relation-aware neighborhood matching,RNM)[8]引入邻域匹配的关系感知方法模型对GCN实体对齐进行校正;

邻域匹配网络(neighborhood matching network,NMN)[9]通过考虑拓扑结构和邻里相似性估计两个实体的相似性,以解决知识图谱中无处不在的邻里异质性;

双曲嵌入下的图卷积网络(hyperbolic graph convolutional network,HGCN)[10]引入高速门机制,控制GCN结构中的噪声传播,使用实体表示进行近似关系表示,从而优化关系对齐的目标。

Ali Net[11]考虑了多跳实体的局部结构,并将等效实体对的两个实体限制为每个图注意力网络(graph attention network,GAT)层具有相同的隐藏状态。IMEA(informed multi-context entity alignment)[12]通过Transformer模型汇集上下文信息,设计基于嵌入相似性和关系以及实体功能的整体推理来评估对齐概率。MRAEA[13]考虑在图神经网络框架下,将关系划分为一些元关系,学习彼此之间的注意力参数,并将它们集成到实体表示中。最后,以半监督方式训练模型。此外还有以注意力机制、长短记忆网络(long short-term memory,LSTM)、BERT(bidirectional encoder representation from transformers)为基础模型的方法等[14]。

RDGCN[7]利 用注意力机制对原始图和 对偶关系图交互建模。JAPE[15]和GCN-Align[5]利用了实体属性信息,但实体的关系结构信息学习不够充分。RNM[8]模型利用邻域匹配来增强实体对齐,除了在匹配邻域时比较邻居节点之外,还尝试从连接关系中探索有用的信息。此外,迭代框架旨在以半监督的方式利用实体对齐和关系对齐之间的积极交互。但是RNM并未考虑属性信息,以及前期采用GCN学习关系结构能力不足。

对于上述实体对齐研究中存在的问题,本文提出了一种结合属性信息与对偶注意力的实体对齐关系感知邻域匹配模型。本文的主要内容如下。

1)在RNM模型中引入了RDGCN的对偶注意力机制,用RDGCN替换原来RNM模型中GCN[16]模型。

2)在RNM模型中增加属性信息,借鉴GCN-Align的属性模块,将属性信息使用GCN进行学习。

3)将RDGCN处理的关系结构信息与属性信息联合学习,作为前期的矩阵嵌入,然后使用关系感知邻域匹配模型进行实体对齐。

知识图谱形式化表示为

式中,E、R、A、V、T分别表示知识图谱中的实体、关系、属性、属性值、知识三元组集合。知识图谱中的一个关系三元组表示为

式中,h、r、t分别表示一个实例化具体的关系三元组的头、关系和尾。

属性三元组表示为

式中,h、a、v分别表示一个实例化具体的属性三元组的头、属性和属性值。

实体对齐的任务是给定两个需融合的知识图谱:G1=(E1,R1,A1,V1,T1),G2=(E2,R2,A2,V2,T2)以及给定预对齐的实体对(种子)L={(e1,e2)|e1∈E1,e2∈E2,e1=e2},通过技术方法找出剩余的等价实体对,式中e1表示在知识图谱G1中实体集E1中的一个具体实例,e2同理。实体对齐案例如图1所示。关系对齐的任务是从给定的两个知识图谱中找出意义相同的关系对。

图1 实体对齐实例Fig.1 Entity alignment instance

本文在RNM模型基础上,引入RDGCN模型模块和实体属性模块。设计了结合属性信息与对偶注意力机制的关系感知匹配模型的实体对齐框架(见图2)。首先通过RDGCN模型学习实体的结构信息,然后通过GCN模型学习实体的属性信息,通过联合属性与实体的模块依据不同权重,联合学习实体结构和属性信息。最后将联合RDGCN模型和属性信息的模型作为矩阵输入,通过关系感知邻域模块校正关系匹配,达到最优的实体对齐效果。

图2 本文框架Fig.2 Overall framework

2.1 RDGCN模型

图3 RDGCN模型[7]Fig.3 RDGCN model[7]

给定输入知识图谱,首先构造对偶关系图,其顶点表示原始知识图谱的关系,利用注意力机制鼓励对偶关系图和原始图之间的相互作用,然后将原始图中的顶点表示形式输入具有高速神经网络门控制的GCN层以捕获邻居的结构信息,最终实体表示将用于确定两个实体是否应对齐。

2.1.1 构造对偶关系图 将G1、G2作为原始图,ςe=(V e,εe),其中顶点集V e=E1∪E2,关系集εe=T1∪T2。给定原始的两个知识图谱ςe,其对偶关系图ςr=(V r,εr)构造如下:①对于ςe中的每种关系r,都有顶点v r∈V r,所以V r=R1∩R2;

②如果两个关系r i和r j共享头实体或尾实体,在ςr中创建边连接节点

根据头实体和尾实体的情况,为对偶关系图中的边u rij定义权重

式中,H i和T i对应关系r i的头实体集合和尾实体集合,构造对偶图的开销和原始图中的关系类型的数量成正比。

1)对偶注意力层

对偶关系图引入关系信息,将关系信息与原始图合并,并使用统一表示。在此应用GAT来迭代地获得对偶关系图和原始图的顶点表示,其中注意力机制有助于促进两图之间的交互。每个双原始交互包含两层,双注意力层和原始注意力层,可以堆叠多个交互以在两个图上相互改进。

令X r∈R m×2d为输入知识图谱的对偶顶点表示矩阵,其中每一行对应关系图ςr中的一个顶点。利用原始注意力层产生的原始节点特征x̂e计算对偶注意力分数

通过将ςe中的平均头实体和尾实体表示进行连接,近似表示成r i的关系表示为c i,c i由原始注意力层求得,

式中,和是从前一个原始注意力层求得的关系r i的第k个头节点和第l个尾节点的输出表示。

2)原始注意力层

在这一层中,当在原始知识图谱上应用GAT时候,使用ςr中的对偶顶点表示计算原始注意力分数,对应于原始知识图谱ςe中的关系。

X e∈R n×d为输入知识图谱的原始顶点表示矩阵,对于原始知识图谱ςe中的实体e q,其表示可以通过下式计算:

模型中,原始顶点的初始表示矩阵X e_in i t使用实体名进行初始化,这为实体对齐提供了重要依据。因此,通过混合原始注意力层的输出和初始表示来保存数据:

2.1.2 合并结构信息 在对偶关系图和原始图之间进行多轮交互后,能够从原始图收集关系感知的实体表示。接下来,应用带有高速路神经网络门控的双层GCN[16]来进一步合并来自邻居的结构信息。

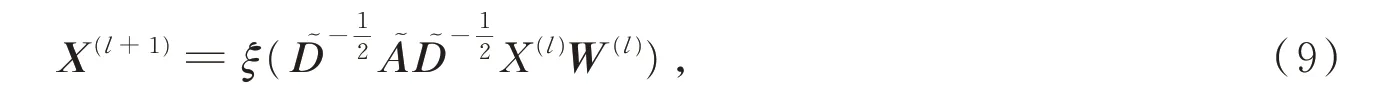

在每一层GCN层l中,输入为实体表示X(l),输出表示为

式中,͂=A+I为原始ςe邻接矩阵;

I表示单位矩阵;

ξ为激活函数ReLU;

W为权重矩阵;

D为度矩阵。为了使数据信息在两个方向流动,在构造A时,把ςe看作无向图。

2.1.3 RDGCN关系结构对齐 从GCN层的输出中收集最终的实体表示,两个实体之间的距离作为对齐分数

式中,为G1中e1的实体表示;

为G2中e2的实体表示;

D(e1,e2)为两实体e1(来自G1)和e2(来自G2)在相同L1范数规则空间的距离;

L1为距离为哈曼顿的L1范数。

2.2 属性结构嵌入模块(完全属性)

依据图卷积对齐[5]的思想将属性单独分析。属性结构嵌入使用GCN模型,并采用完全属性矩阵,不考虑与关系结构矩阵连接,在此与田江伟等[17]和Wang等[5]将属性信息与GCN联合训练的方法有所不同。将属性当作节点对待,从而形成一个实体以属性为边连接起来的知识图谱。如果实体拥有某一个属性,那么实体与该属性之间就有一条边连接。因此,在GCN模型的连接矩阵中,实体只与属性有连接,实体与实体之间无连接,连接矩阵的维度为属性的数量。与关系结构相同,采用随机初始化的节点向量作为第一层的输入,卷积过程表示为

式中,γa>0为间隔超参数;

f(x,y)=||x,y||1;

e a为实体基于属性结构的嵌入向量。采用随机梯度下降(stochastic gradient descent,SGD)来最小化上述损失函数。

2.3 联合对齐模块

在获得实体基于关系结构和属性结构的嵌入向量后,分别计算实体基于关系结构和属性结构两个方面相似性,然后通过加权求和得到实体之间的相似性。最终的相似性实体距离函数定义为

式中,f(x,y)=||x-y||1;

h s(·)和h a(·)分别为关系结构嵌入和属性嵌入;

d s和d a分别表示RDGCN关系结构嵌入和属性嵌入的维度;

εs+a和λs+a是平衡两种嵌入重要性的超参数。

2.4 关系感知邻域匹配模型

2.4.1 实体嵌入 将GCN的输入作为实体的嵌入,并定义实体的表示形式

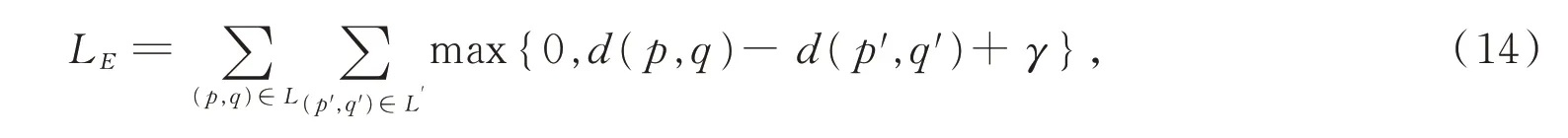

为了将两个知识图谱的实体嵌入到相同的潜在空间中,将种子对齐作为训练数据,并为实体对齐设计一个基于边缘的损失函数,如下所示:

式中,L表示已对齐的种子实体对;

L′表示最近邻抽样时的一组负对齐;

γ是分隔正负实体对齐的边距超参数。损失函数假设对齐的实体对之间的距离应该接近于零,而负样本之间的距离应该尽可能远。

2.4.2 关系嵌入 利用连接实体的信息,从GCN中学习到的头实体和尾实体的嵌入来表示知识图谱中的关系

式中,r∈R2d͂表示r∈R1∪R2的嵌入;

conc at表示串联操作分别表示关系r的所有不同头实体和尾实体的平均嵌入。

此外,为了进一步探索基于三元关系的平移信息,采用类似翻译模型TransE[18]的正则化器:

式中,T1、T2分别表示给定的两个知识图谱G1、G2的三元组集;

W R∈R d͂×2d͂表示从潜在关系空间到潜在实体空间的转换矩阵,为待学习的模型参数。

为了共同学习实体和关系的嵌入,在实体嵌入的预训练后最小化目标函数

式中,λ是一个权衡系数,用于在考虑关系嵌入的情况下平衡实体对齐的损失和正则化器的损失。

2.4.3 实体对的关系感知邻居匹配 GCN旨在聚合来自相邻节点的信息,但也可能带来来自邻居的一些额外噪声。为了减少这些噪声的影响,使用一个关系感知邻域匹配模型来比较实体对。假设来自不同知识图谱的两个实体已经对齐,那么具有相同含义的关系,可以根据关系的映射属性推断出两个指向尾实体的对齐概率。例如,1对1关系可以提供精确对齐,而1对N关系只能表示1/N的概率。

对于每个候选实体对{(e i,e′j)|e i∈E1,e j∈E2},除了成对比较它们的一跳邻居实体之外,还应考虑了连接关系之间的比较。具体地,设N e i为e i在G1中的一步邻实体集合,N e′j为e′j在G2中的一步邻实体集合。对于关于e i和e′j的邻域匹配,比较C e i j={(n1,n2),(r1,r2)|n1∈N e i,n2∈N e′j,

(e i,r1,n1)∈T1,(e′j,r2,n2)∈T2}。之后,本文关注具有匹配关系的匹配邻居,这对实体对齐至关重要。因此,匹配集M eij被定义为C ei j的子集,其中元素满足(n1,n2)∈L e且(r1,r2)∈L r,其中L e表示实体的对齐集,L r表示关系对齐集。

此外,连接关系的映射属性对于实体对齐也很重要。因此,对于中的每个匹配案例,将根据r1、r2和n1、n2计算对齐概率,可以表示为

式中,λe是一个超参数,用于控制嵌入距离和匹配分数之间的权衡。匹配分数越高表示候选实体对的对齐概率越高。

式中,λr是权衡系数。与实体对的距离度量类似,同时考虑关系对的嵌入距离和匹配分数。

3.1 数据集

本文在实验中使用DBP15K数据集[15](见表1),该数据集是从DBpedia[4]生成的。DBpedia是一个包含不同语言版本之间丰富的语言间链接的大型多语言知识图谱。DBpedia的中文、英文、日文和法文版本的子集按照一定的规则选择。

表1 数据集信息Tab.1 Dataset information

3.2 实验设置

3.2.1 实验平台 训练平台采用服务器规格为Intel 4210R/2XTesla V100-32G GPU、8核CPU、40G RAM,模型框架为TensorFlow。

3.2.2 评价指标 使用Hits@k作为评估指标来评估所有方法。Hits@k衡量排在前k个候选数据中的正确对齐实体的比例。M R R为正确对齐结果的倒数排名的平均值。Hits@k或M R R越

高表示模型的性能越好。

3.2.3 参数设置 在此遵照RDGCN、GCN-Align属性模块(AE)以及RNM的原文参数设置,在同一台机器上进行实验,以确保实验的准确性。

所有模型包括本文方法均使用30%的先验对齐实体作为训练集,剩下的70%作为测试集。RDGCN模块参数设置为:β1=0.1,β2=0.3,γ=1.0。对偶(双)和原始注意力层中隐藏表示的维度为d=300、d′=600和d͂=300。GCN层中隐藏表示的所有维度均为300。学习率设置为0.001,采样K=125,每训练10个epoch生成一次负实体对,共训练600个epoch。

属性模块参数设置为:采用SGD优化算法对模型更新迭代2 000次,超参数设置为:γa=3,d a=300,GCN第一层的输出维度、第二层的输入维度和最后的输出维度都相等。

联合结构与属性模块:公式(13)中εs+a=0.9,λs+a=0.1。

关系感知邻域模块设置为:使用一个2层GCN来学习实体嵌入。GCN中隐藏层的尺寸结构和属性分别设置为d s=300,d a=300;

学习率设置为0.001。种子对齐比例为30%。将边界γ设为1,学习率λ设为0.001,阈值δe为5,阈值δr为3,λe设为10,λr设为200。选择最近的100个实体和最近的20个关系作为匹配的候选对象。设每个正样本的负样本数为125。最大迭代次数T设置为4。首先公式(14)优化为50个epoch,然后使用公式(17)联合训练嵌入10个epoch。

3.3 结果分析

3.3.1 消融实验 本文方法的总体模型为RNM+RDGCN+AE,为了清晰本文各个模块的效果,进行消融实验,将RNM+RDGCN+AE模型消融为RNM+RDGCN和RNM+AE两个模型。在实验中,将本文的方法与RNM[8]方法进行比较。通过表2所示,在本文的3个模型中,即总体模型(RNM+RDGCN+AE)以及消融分化的两个模型(RNM+RDGCN和RNM+AE),模型RNM+AE达到最优性能,在三个数据集ZH-EN、JA-EN、FR-EN上的指标@1准确率分别可达到86.91%、87.67%和94.05%。

RNM引入RDGCN模型(RNM+RDGCN)作为前期结构学习时,与RNM相比,效果有增有减,例如,在数据集ZH-EN上@1为84.53%,不及RNM的84.57%,但在指标@10和@50上的91.84%和93.40%,高于RNM的91.73%,93.00%。其原因可能是后期的关系感知邻域匹配模型对关系的正确校正起了很大的作用,能有效校正RNM前期的GCN结构模块学习的不足。

RNM引入RDGCN模型并增加属性模型(RNM+RDGCN+AE)作为前期的结构与属性信息学习时,相比较RNM和RNM+RDGCN对齐精度都有较大的提升力度。例如,在数据集ZH-EN上,RNM+RDGCN+AE在指标@1上为86.30%,高于RNM和RNM+RDGCN的84.57%和84.53%。在指标@10和@50上也是如此,分别为94.58%和96.32%,达到了3个模型中的最佳值。这是由于RNM并没有考虑属性信息,说明属性信息的辅助能有效提升实体对齐的效果。

RNM引入属性模型(RNM+AE)具有最佳的表现,甚至高于RNM+RDGCN+AE模型。例如,在数据集ZH-EN与JA-EN上,@1分别为86.91%和87.67%,高于RNM+RDGCN+AE的86.30%和86.92%。其原因是RNM的关系感知邻域匹配模型对实体的关系匹配达到的效果比较好,能够校正前期GCN实体结构学习的不足。

3.3.2 不同方法结果对比 表2列举了多种方法的对比结果。JAPE首次在表示学习中引入属性信息,由于表示学习在实体对齐中的精确度基准普遍不高,因此JAPE表现不佳,例如在数据集ZH-EN上@1为41.18%。

表2 方法对比结果Tab.2 Comparison method results /%

GCN-Align首次将GCN引入实体对齐任务中,并联合属性信息一起学习,但该方法只以基础GCN为模型,没有对其拓展,在数据集ZH-EN的@1上也只有41.25%。RDGCN通过对GCN进行拓展,在数据集ZH-EN的@1上达到了70.75%。鉴于此,后面很多方法均在此基础上进行拓展,提高了实体对齐任务的有效性。所以当前实体对齐任务中以GCN为基准的实体对齐方法更多一些[14]。

一些方法以GCN为基础模型,以辅助信息作为提升性能的手段,如KGEA[19]以词嵌入调用上下文,利用LSTM以及注意力机制辅助提取上下文信息,以完成实体对齐任务。由于LSTM以GCN为基准,在数据集ZH-EN、JA-EN、FR-EN的指标@1上分别为54.6%、64.6%和79.6%,在对齐任务上表现不佳。

同 样 以 上 下 文 信 息 为 例 的CTEA(context and topic enhanced entity alignment)[20]方 法,以GCN为基础模型,使用GCN和TransE并行处理实体对齐任务,虽然效果不错,但是并未在GCN上和Trans E上做扩展提升,例如在ZH-EN上的@10为90.50%。再以辅助信息为例,HMAN[21]引入BERT变种模型,试图使用上下文信息,虽然精确度很高,但由于BERT时间复杂度过大,且BERT操作不方便,其在数据集ZH-EN上的@1为56.20%。

只以GCN为拓展,如RDGCN对GCN引入注意力机制加强实体信息学习能力,但不及只使用循环迭代的RNM。RDGCN在ZH-EN、JA-EN、FR-EN的@1上表现为70.75%、76.74%、88.64%,不及RNM的84.57%、86.95%、94.38%。

基于双重注意力和关系语义建模的实体对齐方法[22],与RDGCN方法有相似的思想,都以GCN为基础,使用注意力机制。双重注意力和关系语义建模方法以关系语义作为辅助信息效果,而本文以属性信息作为辅助信息。基于双重注意力和关系语义建模的实体对齐方法,采用以GCN加注意力机制为提升的基础上再加辅助关系语义信息的提升效果不如RNM,ZH-EN、JA-EN、FR-EN的@1上分别为81.00%、83.90%、92.73%,不及RNM的84.57%、86.95%、94.38%。

本文提出结合属性信息与对偶注意力机制的实体对齐的关系感知邻域匹配模型,引入实体对齐的关系感知邻域匹配模型中没有考虑的属性信息,同时引入RDGCN的对偶注意力机制以优化RNM方法中GCN结构学习能力的不足。在3个跨语言数据集进行仿真,验证了对偶注意力以及属性信息对实体对齐方法的有效性。

猜你喜欢 邻域对偶图谱 基于图对比注意力网络的知识图谱补全北京航空航天大学学报(2022年8期)2022-08-31“植物界大熊猫”完整基因组图谱首次发布军事文摘(2022年16期)2022-08-24基于混合变邻域的自动化滴灌轮灌分组算法农业工程学报(2022年7期)2022-07-09对偶τ-Rickart模兰州理工大学学报(2022年3期)2022-07-06基于近邻稳定性的离群点检测算法电子技术与软件工程(2019年8期)2019-07-16图表新城乡(2018年6期)2018-07-09例析对偶式在解三角问题中的妙用理科考试研究·高中(2016年10期)2017-01-17怎样利用对偶式处理高考解几问题理科考试研究·高中(2016年10期)2017-01-17对函数极值定义的探讨知识力量·教育理论与教学研究(2013年11期)2013-11-11邻域平均法对矢量图平滑处理现代电子技术(2009年14期)2009-09-05- 范文大全

- 说说大全

- 学习资料

- 语录

- 生肖

- 解梦

- 十二星座

-

主题党日活动交流发言8篇

主题党日活动交流发言8篇主题党日活动交流发言篇13月13日,东城区党史学习教育动员大会召开。市委

【活动总结】 日期:2022-12-23

-

2022年4月主题党日活动记录范文15篇

2022年4月主题党日活动记录范文15篇2022年4月主题党日活动记录范文篇1一个崇尚阅读的民族,必然精神饱满、意气风发、活力四射。习近平总书记强调:“学习

【活动总结】 日期:2022-08-01

-

家乡赋|最美的家乡赋

家乡赋 孙传志 今安康市,白河双丰镇,吾之家乡也。三环沃土,山水环抱。其北依山,山系五岭,山

【调研报告】 日期:2020-04-01

-

【人教版1-6年级数学上册知识点精编】1-6年级数学人教版教材

人教版二年级数学上册知识点汇总第一单元长度单位一、米和厘米1、测量物体的长度时,要用统一的标准去测量

【调研报告】 日期:2020-11-08

-

党支部1-12月全年主题党日活动计划表

2022年党支部主题党日活动计划表序号活动时间活动方式活动内容12022年1月专题学习研讨集中观看2022年新年贺词,积极开展学习研讨交流。组织生活会组织党员认真对照党章...

【活动总结】 日期:2022-10-14

-

2022年2月份主题党日活动记录5篇

2022年2月份主题党日活动记录5篇2022年2月份主题党日活动记录篇1尊敬的党组织:在今年的开学初,本人积极参加教研室组织的教研活动,在学校教研员的指

【活动总结】 日期:2022-08-12

-

医院最佳主题党日活动11篇

医院最佳主题党日活动11篇医院最佳主题党日活动篇1 医院最佳主题党日活动篇2为隆重纪念中国共产党成立100周年,进一步巩固党的群众路线教育实践活动成果,切实

【活动总结】 日期:2022-10-29

-

2023年平安校园建设方案13篇

平安校园建设方案“平安校园”创建工作,我们幼儿园全体教职员工一直把它当作头等大事来抓。领导高度重视,以“平安校园”创建活动为抓手,建立和规范校园安全工作机制

【规章制度】 日期:2023-11-02

-

主题党日活动记录202210篇

主题党日活动记录202210篇主题党日活动记录2022篇12021年是中国共产党成立100周年,为广泛开展爱国主义宣传教育,铭记党的历史,讴歌党的光辉历程,

【活动总结】 日期:2022-08-02

-

南京大屠杀国家公祭日悼念文案句子11篇

南京大屠杀国家公祭日悼念文案精选句子1、惟有民魂是值得宝贵的,惟有他发扬起来,中国才有真进步。——鲁迅2、我爱我的祖国,爱我的人民,离开了它,离开了他们,我

【企划文案】 日期:2023-10-20

-

正式的晚宴邀请函 公司晚宴邀请函

尊敬的先生 女士: 我公司谨定于xxxx年xx月xx日xx:xx在xxxx店隆重举行xx市xx届xxxx晚宴(宴会地址:xx区xx路xxxx) 敬请届时光临!xxxxxx集团股份有限公司xxxx有限公司敬邀xxxx年xx月xx日

【简历资料】 日期:2019-08-03

-

《国行公祭,为佑世界和平》课文原文阅读_国行公祭为佑世界和平每段段意

国行公祭,为佑世界和平钟声“国行公祭,法立典章。铸兹宝鼎,祀我国殇。”侵华日军南京大屠杀遇难同胞纪念

【简历资料】 日期:2020-11-28

-

一年级新学期目标简短_一年级学生新学期打算

新学期到了,我是一年级下册的小学生了。 上课的时候,我要认真学习,不做小动作,认真听讲。我要认真学习,天天向上,努力学习,耳朵要听老师讲课,眼睛要瞪得大大的看老...

【简历资料】 日期:2019-10-26

-

[信访复查复核制度作用探讨]信访复查复核有用吗

作为我国特有的一项制度,信访制度的出现并长期存在不是偶然的,虽然一些法学专家认为信访制度具有“人治”

【职场指南】 日期:2020-02-16

-

[党员干部2019年主题教育个人问题检视清单及整改措施2篇] 党员干部

2019年主题教育问题检视清单及整改措施根据主题教育领导小组办公室《关于认真做好主题教育检视问题整改

【求职简历】 日期:2019-11-08

-

网络维护工作内容_(精华)国家开放大学电大专科《网络系统管理与维护》形考任务1答案

国家开放大学电大专科《网络系统管理与维护》形考任务1答案形考任务1理解上网行为管理软件的功能【实训目

【职场指南】 日期:2020-07-17

-

党委会与局长办公会的区别_局长办公会制度

为进一步加强xxx局工作的规范化、制度化建设,提高行政效能,规范议事程序,特制定本制度。一、会议形式1、局长办公会议由局长、副局长参加。由局长召集和主持。根据工作需要...

【求职简历】 日期:2019-07-30

-

《铁拳砸碎“黑警伞”》警示教育片观后感

影片深刻剖析了广西北海市公安局海西派出所原所长张枭杰蜕变堕落的轨迹。观看警示教育片后,做为一名党员教

【简历资料】 日期:2020-08-17

-

如何凝心聚力谋发展【坚定信心谋发展凝心聚力促跨越】

当前,清河正处于在苏北实现赶超跨越基础上全面腾飞的战略机遇期,处于在全市率先实现全面小康基础上率先实

【简历资料】 日期:2020-03-17

-

学生会组织部部长竞选稿5篇

学生会组织部部长竞选稿以“三制”为统领推进农村党的建设中共**市委组织部近年来,**市认真落实中央、省和徐州市委的部署,积极适应发展要求,从加强领导体制、运

【求职简历】 日期:2023-11-06

-

淮安市洪泽区全会报告【优秀范文】

推进绿色发展推动富民强区加快建设现代化湖滨生态旅游新城在区委十一届三次全会上的讲话同志们:今年是党的十九大召开之年,也是区委作出打造五区一极和建设现代化湖滨生态旅...

【其他范文】 日期:2022-10-20

-

2022年度“铁”字写作提纲

“铁”字写作提纲1 勇做基层“铁榔头”做基层的“铁榔头”,逆流而上、永不放弃做基层的“铁榔头”,团结协作、勇攀高峰做基层的“铁榔头”,适时归零、重新出发2 用铁肩担...

【其他范文】 日期:2022-09-21

-

电网不平衡下基于SOGI的MMC环流抑制策略

周诗丁,王顺亮,张英敏,马俊鹏,冯麟,单鹏(四川大学电气工程学院,四川成都610065)由于MMC具

【其他范文】 日期:2023-06-28

-

数据爬取不正当竞争认定的反思与转进

丁国民,陈子剑(福州大学法学院,福建福州350108)2021年3月,第十三届全国人大四次会议表决通

【其他范文】 日期:2023-06-26

-

[团干培训大会主持稿] 团干交流会主持稿

大会即将开始,请大家保持会场安静,并将手机等通讯工具调至静音或关闭状态,谢谢合作!(可重复) 尊敬的老师,亲爱的同学门: 大家上午好!欢迎各位参加xxx学院第三届...

【毕业论文】 日期:2019-10-03

-

2022年度强国有我,请党放心发言要点(全文完整)

以下是为大家整理的关于强国有我,请党放心的发言要点3篇,供大家参考选择。强国有我,请党放心的发言要点3篇【篇一】强国有我,请党放心的发言要点请党放心强国有我朗诵词绵绵崛...

【其他范文】 日期:2023-01-02

-

水力空化技术在水处理领域的研究进展

洪锋袁喜刘书畅彭钦天施妍金蕾田海林叶立群贾金平应迪文黄应平(1 三峡库区生态环境教育部工程研究中心(

【其他范文】 日期:2023-01-19

-

Extracellular,vesicles,from,oviductal,and,uterine,fluids,supplementation,in,sequential,in,vitro,culture,improves,bovine,embryo,quality

CláudiaLimaVerdeLeal,KarinaCañón-Beltrán,YuliaN Ca

【其他范文】 日期:2023-06-30

-

[反违章工作总结]反违章心得体会800字

安全监察部:今年以来,我们在省公司、分公司的安排下,进行了反违章工作的宣传和部署,在本公司范围内开展了以消灭装置性违章、杜绝管理性违章、控制行为性违章为主要内容的...

【节日庆典】 日期:2019-08-28

-

进一步加强通知集合3篇

进一步加强通知集合各银监局,各政策性银行、国有商业银行、股份制商业银行:最近,有关部门就人民币汇率形成机制和我国银行间外汇市场出台了一系列改革措施,

【评语寄语】 日期:2024-03-01

-

军转座谈会交流发言4篇

军转座谈会交流发言4篇军转座谈会交流发言篇1大家好,我叫贺丽,2015届选调生,来自康定市委组织部,现在省委编办跟班学习。今天,非常荣幸向大家汇报我的学习收

【发言稿】 日期:2022-10-27

-

12岁生日小寿星发言4篇

12岁生日小寿星发言4篇12岁生日小寿星发言篇1各位来宾、各位朋友:大家好!今天,我们欢聚在这里,共同庆祝**十二周岁生日。首先,我代表**的父母以

【发言稿】 日期:2022-07-31

-

党内警告处分党员讨论发言3篇

党内警告处分党员讨论发言3篇党内警告处分党员讨论发言篇1大家好!作为新时期的一名大学生,认真学习、深刻领会、全面贯彻省党代会精神,是当前和今后一个时期重

【发言稿】 日期:2022-08-07

-

廉政大会总结发言稿7篇

廉政大会总结发言稿7篇廉政大会总结发言稿篇1各位领导,同志们:根据会议安排,我就党风廉政建设工作做表态发言,不妥之处,请批评指正。一、提高认识,切实

【发言稿】 日期:2022-10-30

-

被约谈的表态发言8篇

被约谈的表态发言8篇被约谈的表态发言篇1各位领导、各位党员大家好:这天我能站在鲜红的党旗下,

【发言稿】 日期:2022-12-24

-

破冰提能大讨论个人发言4篇

破冰提能大讨论个人发言4篇破冰提能大讨论个人发言篇1党史学习教育开展以来,我坚持读原著、学原文、悟原理。今天,根据会议安排,现在我就“学史明理”主题谈几点个

【发言稿】 日期:2022-10-09

-

我最敬佩的人开头_我敬佩的一个人作文20篇2020年

我敬佩的一个人作文20篇 我敬佩的一个人作文一): 我身边有很多值得我们敬佩的人,但我最敬佩的一

【发言稿】 日期:2020-11-10

-

党员教育培训总结交流发言12篇

党员教育培训总结交流发言12篇党员教育培训总结交流发言篇1根据市委组织部《关于开展我市〈20XX

【发言稿】 日期:2022-12-19

-

纪委书记工作表态发言4篇

纪委书记工作表态发言4篇纪委书记工作表态发言篇1在镇党委政府正确领导下,在全村干部和群众的共同努力下,紧紧围绕建设社会主义新农村工作为重点,尽职尽责,与时俱

【发言稿】 日期:2022-09-30

-

[钻井队队长(副队长、指导员)岗位HSE应知应会试题(1863)]

钻井队队长(副队长、指导员)岗位HSE应知应会试题(判断题:771;单选题:626;多选题:466)

【贺词】 日期:2020-09-23

-

学习周永开先进事迹心得体会3篇

学习周永开先进事迹心得体会【一】通过学习周永开老先生先进事迹后,结合自己工作思考,感慨万千。同样作为

【格言】 日期:2021-04-10

-

XX老干局推进党建与业务深度融合发展工作情况调研报告:党建调研报告

XX老干局推进党建与业务深度融合 发展工作情况的调研报告 党建工作与业务工作融合发展始终是一个充满生

【成语大全】 日期:2020-08-28

-

中国共产党第三代中央领导集体的卓越贡献

中国共产党第三代中央领导集体的卓越贡献 --------------继往开来铸就辉煌 【摘要】改

【成语大全】 日期:2020-03-20

-

信息技术2.0能力点 [全国中小学教师信息技术应用能力提升工程试题题库及参考答案「精编」]

全国中小学教师信息技术应用能力提升工程试题题库及答案(复习资料)一、判断题题库(A为正确,B为错误)

【格言】 日期:2020-11-17

-

党建工作运行机制内容有哪些_构建基层党建工作运行机制探讨

党的基层组织是党在社会基层组织中的战斗堡垒,是党的全部工作和战斗力的基础。加强和改进县级以下各类党的

【经典阅读】 日期:2020-01-22

-

电大现代教育原理_最新国家开放大学电大《现代教育原理》形考任务2试题及答案

最新国家开放大学电大《现代教育原理》形考任务2试题及答案形考任务二一、多项选择题(共17道试题,共3

【成语大全】 日期:2020-07-20

-

集合推理_七,推理与集合

七推理与集合1 期中考试数学成绩出来了,三个好朋友分别考了88分,92分,95分。他们分别考了多少分

【名人名言】 日期:2020-12-18

-

基层党务工作基本内容_党建基本工作有哪些

党建基本工作有哪些(一) 基层党建工作包括哪些内容 选择了大学生村官这条路,你就与农村基层党

【名人名言】 日期:2020-08-06

-

2023年中国行政区划调整方案(设想优秀3篇

中国行政区划调整方案(设想优秀民政部第二次行政区划研讨会会议内容一、缩省的意义与原则1.意义1)利于减少中间层次中国行政区划层级之多为世界之最,既使管理成本

【周公解梦】 日期:2024-02-20

-

[人生赠言]城隍庙人生赠言注释

人之相惜惜于品,人之相敬敬于德,人之相交交于情,人之相随随于义,人之相拥拥于礼,人之相信信于诚,人之相伴伴于爱! 人生的确很累,看你如何品味,每天多寻欢乐,烦...

【格言】 日期:2019-07-14

-

关于三农工作重要论述心得体会3篇

关于三农工作重要论述心得体会3篇关于三农工作重要论述心得体会篇1习近平总书记指出:“建设现代化国家离不开农业农村现代化,要继续巩固脱贫攻坚成果,扎实推进乡村

【学习心得体会】 日期:2022-10-29

-

【福生庄隧道坍塌处理方案】 福生庄隧道在哪里

(呼和浩特铁路局大包电气化改造工程指挥部,内蒙古呼和浩特010050)摘要:文章介绍了福生庄隧道

【学习心得体会】 日期:2020-03-05

-

五个一百工程阅读心得体会13篇

五个一百工程阅读心得体会13篇五个一百工程阅读心得体会篇1凡益之道,与时偕行。在全国网络安全和信

【学习心得体会】 日期:2022-12-07

-

城管系统警示教育心得体会9篇

城管系统警示教育心得体会9篇城管系统警示教育心得体会篇1各党支部要召开多种形式的庆七一座谈会,组织广大党员进行座谈,回顾党的光辉历程,畅谈党的丰功伟绩,

【学习心得体会】 日期:2022-10-09

-

发展对象培训主要内容10篇

发展对象培训主要内容10篇发展对象培训主要内容篇1怀着无比激动的心情,我有幸参加了__新区区委党校20__年第四期(区级机关)党员发展对象培训班。这次的学习

【培训心得体会】 日期:2022-09-24

-

扶眉战役纪念馆心得体会11篇

扶眉战役纪念馆心得体会11篇扶眉战役纪念馆心得体会篇1有那么一段历史,低诉着血和泪的故事,慢慢地,随岁月老去;有那么一群人,放弃了闲逸的人生,辗转奔波中

【学习心得体会】 日期:2022-08-03

-

凝聚三种力量发展全过程人民民主心得体会12篇

凝聚三种力量发展全过程人民民主心得体会12篇凝聚三种力量发展全过程人民民主心得体会篇1新民主主义革命是指在帝国主义和无产阶级革命时代,殖民地半殖民地国家中的

【学习心得体会】 日期:2022-08-31

-

2022年全国检察长会议心得7篇

2022年全国检察长会议心得7篇2022年全国检察长会议心得篇1眼睛是心灵上的窗户,我们通过眼睛才能看到世间万物,才能看到眼前这美好的一切。拥有一双明亮的眼

【学习心得体会】 日期:2022-10-31

-

全面从严治党的心得体会800字7篇

全面从严治党的心得体会800字7篇全面从严治党的心得体会800字篇1中国特色社会主义是我们党领导

【学习心得体会】 日期:2022-12-14

-

教师全国两会精神学习专题研讨交流材料6篇

教师全国两会精神学习专题研讨交流材料6篇教师全国两会精神学习专题研讨交流材料篇1通过对两会精神深入系统的学习,作为新一代的青年人,更应该严格要求自己,贯彻落

【教师心得体会】 日期:2022-08-11

-

2024年主题教育民主生活会批评与自我批评意见(38条)(范文推荐)

2024年主题教育民主生活会批评与自我批评意见(38条)(范文推荐)

2023年主题教育民主生活会六个方面个人检视、相互批评意见:1 理论学习系统性不强。学习习近平新时代中国特色社会主义思想不深不透,泛泛而学的时候多,深学细照的时候少,特...

【邓小平理论】 日期:2024-03-19

-

2024年交流发言:强化思想理论武装,增强奋进力量(完整)

2024年交流发言:强化思想理论武装,增强奋进力量(完整)

习近平总书记指出:“一个民族要走在时代前列,就一刻不能没有理论思维,一刻不能没有思想指引。”党的十八大以来,伴随着新时代中国特色社会主义思想在实践中形成发展的历程...

【三个代表】 日期:2024-03-19

-

2024年度镇年度县乡人大代表述职评议活动总结

2024年度镇年度县乡人大代表述职评议活动总结

xx镇20xx年县乡人大代表述职评议活动总结为响应县级人大常委会关于开展县乡两级人大代表述职评议活动,进一步激发代表履职活力,加强代表与人民群众的联系,提高依法履职水平...

【马克思主义】 日期:2024-03-19

-

“千万工程”经验学习体会(研讨材料)

“千万工程”经验学习体会(研讨材料)

“千万工程”是总书记在浙江工作时亲自谋划、亲自部署、亲自推动的一项重大决策,也是习近平新时代中国特色社会主义思想在之江大地的生动实践。20年来,“千万工程”先后经历...

【三个代表】 日期:2024-03-19

-

2024年在市政协机关工作总结会议上讲话

2024年在市政协机关工作总结会议上讲话

同志们:刚才,XX同志对市政协机关20XX年工作进行了很好的总结,很精炼,很到位,可以感受到去年机关工作确实可圈可点。XX同志宣读了表彰决定,机关优秀人员代表、先进集体代...

【邓小平理论】 日期:2024-03-18

-

在全区防汛防涝动员暨河长制工作推进会上讲话提纲【完整版】

在全区防汛防涝动员暨河长制工作推进会上讲话提纲【完整版】

区长,各位领导,同志们:汛期已经来临,我区城区防涝工作面临强大考验,形势不容乐观。年初,区城区防涝排渍指挥部已经召开专题调度会,修订完善应急预案,建立网格化管理机...

【马克思主义】 日期:2024-03-18

-

2024年镇作风整治工作实施方案(完整文档)

2024年镇作风整治工作实施方案(完整文档)

XX镇作风整治工作实施方案为深入贯彻落实党的二十大精神及省市区委深化作风建设的最新要求,突出重点推进干部效能提升,坚持不懈推动作风整治工作纵深发展,根据《关于印发《2...

【毛泽东思想】 日期:2024-03-18

-

2024市优化法治化营商环境规范涉企行政执法实施方案【优秀范文】

2024市优化法治化营商环境规范涉企行政执法实施方案【优秀范文】

xx市优化法治化营商环境规范涉企行政执法实施方案为持续优化法治化营商环境,激发市场主体活力和社会创造力,规范行政执法行为,创新行政执法方式,提升行政执法质效,着力解...

【毛泽东思想】 日期:2024-03-18

-

2024年度关于开展新一轮思想状况摸底排查工作通知(完整)

2024年度关于开展新一轮思想状况摸底排查工作通知(完整)

关于开展新一轮思想状况摸底排查工作的通知为深入贯彻落实关于各地开展干部职工思想状况大摸底大排查情况上的批示要求和改革教育第二次调度会议精神,有针对性做好队伍教育管...

【三个代表】 日期:2024-03-18

-

2024年公路养护中心主任典型事迹材料(完整文档)

2024年公路养护中心主任典型事迹材料(完整文档)

“中心的工作就是心中的事业”——公路养护中心主任典型事迹材料**,男,1976年6月出生,1993年参加工作,2000年4月调入**区交通运输局工作,大学本科学历,中共党员,现任**...

【马克思主义】 日期:2024-03-17